mtd

MTD Subsystem: từ silicon đến kernel

Giải thích MTD subsystem trong Linux kernel: từ vật lý floating-gate transistor, NOR vs NAND, đến UBI/UBIFS và quy trình flash NAND thực tế.

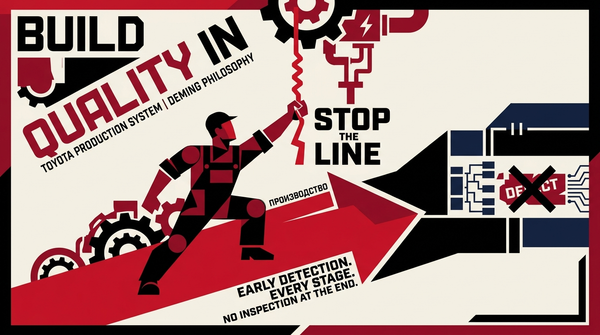

build-quality-in

Anh đồng nghiệp người Đức nói 'build quality in' ở mọi kickoff, chưa bao giờ ở lúc cuối. Mình gật gù nửa năm rồi mới hiểu, đúng lúc tự tay tắt CI để kịp hotfix.

quan-lieu

Game Theory giả định bạn lý trí hoàn hảo. Quan Liêu Theory chỉ giả định bạn đang cố sống sót đến hết giờ làm. Một lý thuyết hoàn chỉnh, kèm định lý, công thức, và citation thật, về vì sao sếp bạn dở mà vẫn lên chức.

ccna

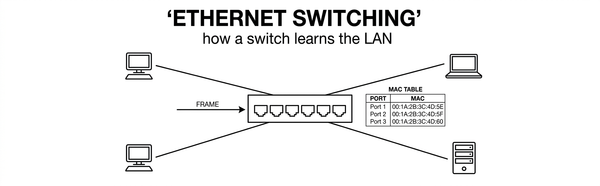

Switch Ethernet mù tịt với IP, chỉ có một phản xạ: nhớ source MAC. Cách switch học, flood và lọc frame, và vì sao mẹo đó vừa hay cũng vừa là lỗ hổng.

ARP spoofing, MAC flooding, VLAN hopping, STP takeover, rogue DHCP - tại sao tầng Data Link vẫn là chỗ dễ bị mò nhất trong enterprise LAN, kể từ một switch phòng lab tới một datacenter Fortune 500.

Các bài về DeepSeek v4 đang được spam ầm ầm trên các group. Các bài đó đúng 80% nhưng 20% còn lại là sai hoặc gây hiểu nhầm. Và tôi nghĩ nếu bạn thật sự muốn hiểu thì bạn nên đọc bài viết này và paper gốc.

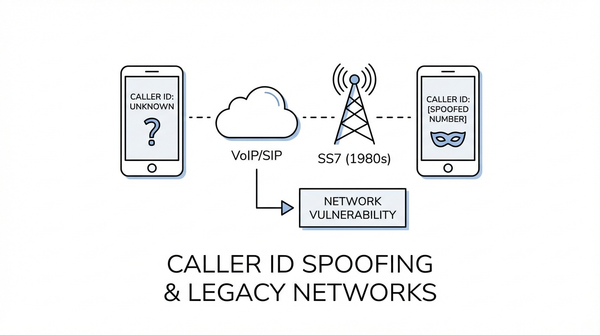

Caller ID spoofing hoạt động vì SS7 thiết kế từ 1980s không có xác thực. Phân tích kỹ thuật từ SIP header đến PSTN Gateway, tại sao Việt Nam đặc biệt dễ bị tấn công.

Mổ xẻ từng byte con RAT trong vụ axios npm supply chain attack: 5 bugs trong malware của hacker Bắc Triều Tiên nhưng vẫn compromise hàng nghìn máy trong 3 tiếng.

Lỗ hổng ẩn giấu gây thiệt hại hàng triệu đô chỉ trong tích tắc

XSS là lỗ hổng web phổ biến và cũng là điểm khởi đầu lý tưởng để hiểu cơ chế bảo mật trình duyệt. Bài viết này không chỉ dừng lại ở việc bật `alert()` đâu.

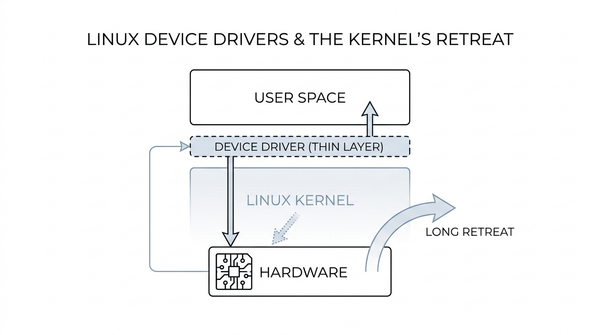

Lệnh /sys/class/gpio mà gần như mọi tài liệu embedded Linux vẫn đang dạy đã bị kernel khai tử từ 2016. Không phải lỗi của ai - đó là dấu vết của một cuộc rút lui có chủ đích: đẩy driver ra khỏi kernel, biến phần cứng từ code thành data.

54 cell benchmark thật trên GB10 128GB. MoE thắng dense 2.5x throughput, long-input giết server, KV cache là constraint thực sự - và 5 điều mình không đoán trước được khi mở terminal.

ARP spoofing, MAC flooding, VLAN hopping, STP takeover, rogue DHCP - tại sao tầng Data Link vẫn là chỗ dễ bị mò nhất trong enterprise LAN, kể từ một switch phòng lab tới một datacenter Fortune 500.

OSI Layer 1 biến bit thành tín hiệu điện, ánh sáng, sóng radio ra sao: encoding NRZ/PAM4, cáp đồng UTP, sợi quang SMF/MMF, Wi-Fi 7 và cáp quang biển Việt Nam.

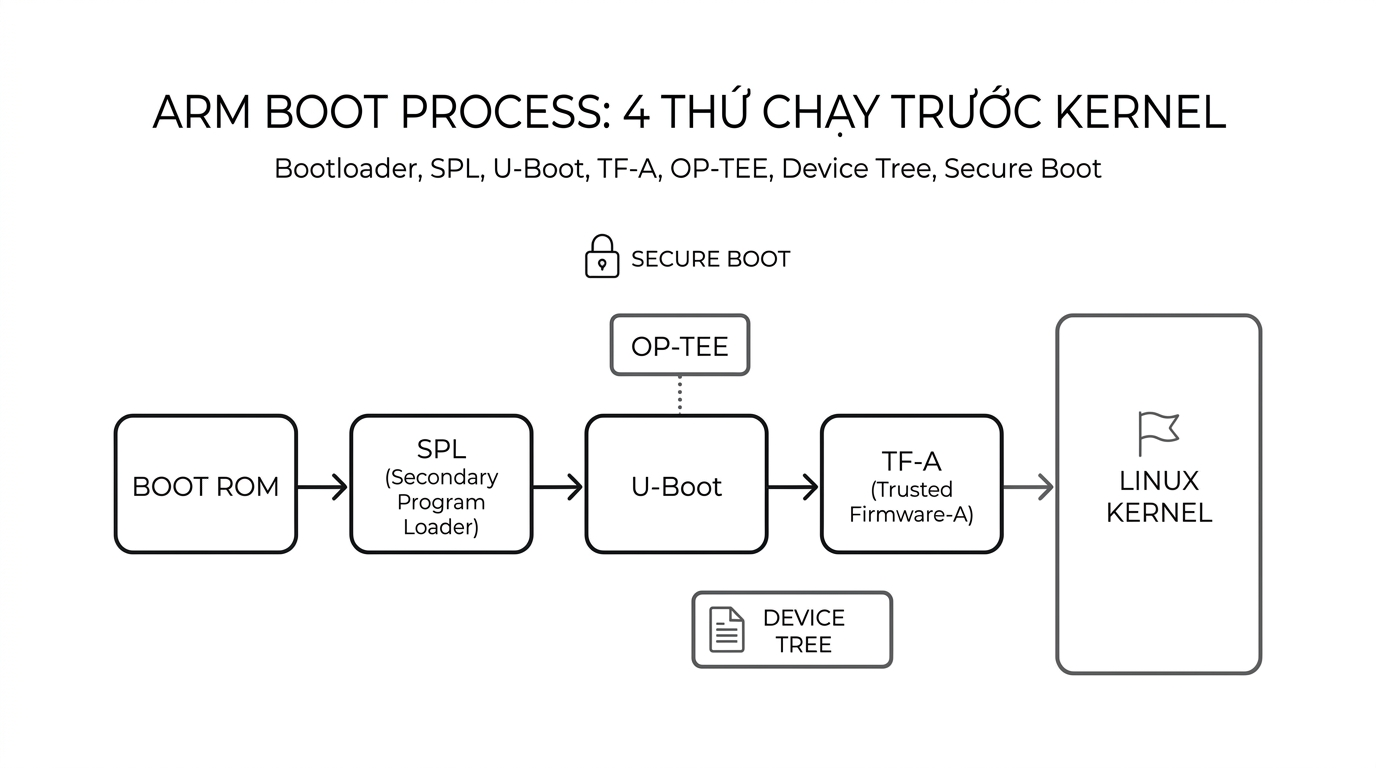

4 stage chạy TRƯỚC kernel trên ARM: ROM → SPL → U-Boot → TF-A. Đào sâu Device Tree, Secure Boot, A/B partition. Hiểu cốt lõi embedded boot.

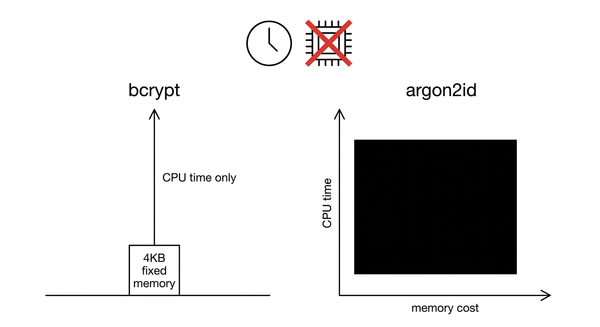

Cùng 200ms wall-clock, bcrypt và Argon2id không cùng bậc an toàn. Benchmark RTX 3070 Ti + lý do hashcat mất 11 năm mới support Argon2 đàng hoàng.

Trường dạy '1/0 không xác định'. Nhưng từ 1857 tới 2001, toán học đã có ba framework cho 1/0 một giá trị rõ ràng: projective line, parallel operator, wheel theory. Đây là cuộc đi bộ qua cả ba, kèm đầy đủ proofs.

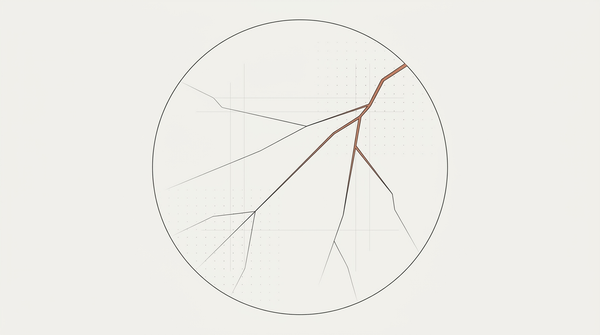

Anthropic giữ 40 cent/đô. FCF Big Tech về 0. Khấu hao GPU 6 năm trên vòng đời 2-3 năm. Capex/revenue 13:1. Năm vết nứt, dự báo Q2/2027.

Một patch tối ưu nhỏ năm 2017, một template ít ai dùng, một syscall zero-copy. Ba thứ tưởng vô hại, ghép lại cho phép user thường thành root chỉ với 732 bytes Python.

Anthropic, Google, OpenAI, DeepSeek, Meta đều quảng cáo 1M token context. Cùng con số, 7 kiến trúc khác nhau bên dưới — và chỉ 3 lab có paper kiểm chứng được.

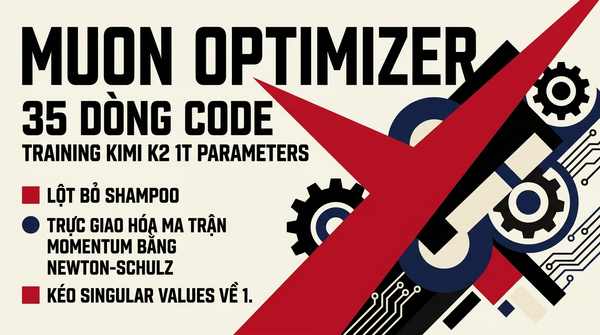

Muon optimizer là Shampoo bị lột bỏ phần chậm, thêm momentum, kiểm chứng bằng 12 kỷ lục NanoGPT speedrun. 52% FLOPs so với AdamW, Kimi K2 dùng thật.

Dat Bike huy động 51M USD, doanh thu 51M USD. Nhưng VinFast bán gấp 13 lần. Lệnh cấm xe xăng 2026 không phải cứu tinh, mà là khoảnh khắc phơi bày yếu điểm chiến lược.